あるフロントエンドエンジニアの1日

Frontrend Advent Calenderの14日目の記事です。

風邪引いてちょっと遅れました…。

先週ですが、札幌でSaCSS Special4 Frontrend in Sapporoというイベントで講演させていただく機会がありました。 自分は"黒い画面"ことターミナルやコマンドに慣れていない方に興味を持ってもらおうという感じで、お話をさせていただきました。

ターミナルに興味が出てきたところで、「どうやって作業してんだろ?」っていうのが見ないと分からなかったりもすると思います。

自分は日常的にターミナル内で作業してるのですが、こんな感じでフロントエンドに関わる作業するのかなーという一例として書いてみます。あくまで イメージです。

- 10:00

- 出社してiTerm2を立ち上げる。

- tmuxとtmuxinatorを使って、その日の作業に対応した、paneとかwindowとか指定してる。

- メールチェックはVmailかAirmailを使い分けしてる。何か返信とかはAirmailで、閲覧はVmailっていうのが多い。

- 11:00

- 12:00

- 14:00

- 15:00

- GitHubを使用したりすること多いので、hubとかgit-extras使って省力化してる。

- 途中で「このfunction名どこで使ってるのかいな…」ということでack使って検索かける。検索がもっと速いって言われるSilver Searcherはあんまり好みじゃない。

- 16:00

- 17:00

- JSONのレスポンスが見にくいので、jqコマンドで整形しておいたり。いらないレスポンスは削ったりする。

- Wikiのドキュメントを追記するのに自分はWiki形式よりMarkdownが良いので、pandocで変換。ドキュメント関係はこれ1本で済んでる。

- MarkdownはVimで書いて、vim-quickrun使って、Marked2を使ってプレビュー。

- 19:00

- styledoccoとjsdoc3のドキュメントを更新しておく。

- この作業もやっぱりGrunt使って作業。インターフェース一緒なので良い。

- お疲れさまでした。

上記はフィクションですが、大体こんな感じかなと。他にサーバーでの作業が必要ってことで、ssh使ったりとかもありますけど。 慣れると(ほぼ)ターミナルで作業が完結して、キーボードしか使わなくなるので便利に思えます。もちろんブラウザでの作業とかありますけど。

まあ、あんまりフロントエンドっぽくない話だなーって気もしますが、こういう人間もいたりするってことで。

それではみなさま良いCUIライフを送ってください。

もしも稲川淳二が桃太郎を朗読したら

これはね、私が山村にロケに行ったときに村の古老って言っても、そうだなぁ80歳くらいですかねぇ。まあ生まれたときからその村に住んでるっていうお爺さんに聞いた話なんですけどね。むかーしむかしその村になかよーく暮してたお爺さんとお婆さんがいらっしゃったそうなんですね。

そのお爺さんがですね、山へその柴をね?刈りにいったんですよ。お婆さんの方はっていうと、川に洗濯に行くっていうね、これがね?その夫婦のだいたいいつもの日課だったんですねぇ。

でもある日川に行ったお婆さんは、なーんかいつもと違う雰囲気を感じたんですって。で、いやだなーなんだろなー怖いなーと思ったら、川の上流から大きーくて見たことないようなね、桃が流れてきたんですよ!

ちょっと現実逃避して書いてしまったけど、ここまでで飽きた。こんなこと書いてる場合じゃない。

SassConfスピーカーのGitHubのアカウントをFollowしたい

現在出張でNYに来ておりまして,初日はSass Confに参加しました. 自分はSassはそんなに使ってたりしませんが,やっぱり初のSassのカンファレンスということで,大変面白く聞いてます. (時差ボケのせいか後半は朦朧としてたけど)

今回自分が全然GitHubでfollowしてない分野が違う人たちだったので,地道に下記のページのリンクからポチポチとfollowしてたんです.

途中から結構数が多いことに気付いて,面倒になったのでスクレイピングして一括してfollowするようなスクリプトを作ってみました. 1回しか使わないけど,便利!

使い方は上記のgistをダウンロードしてきてから,解凍してディレクトリに移動して,

$ npm install

$ node index.js

してもらえれば,終わり.あ,L31~32のID/Passwordは自分のGitHubのアカウントのものに書きかえてくださいね.

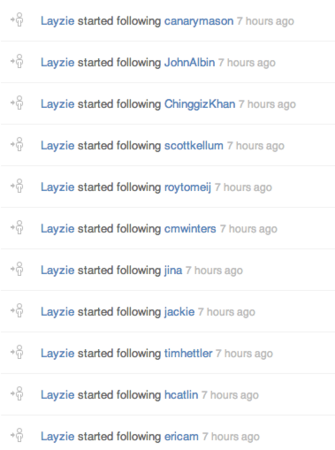

こんな感じになりました.

package.json見ればわかるんですが,mape/node-scraper使ってアカウント拾ってきてそれをajaxorg/node-githubでポストしてるだけです.

scraperはまあjQueryのバージョンが1.3とか古いんですが,別にDOM操作というよりはDOM走査に使うだけなんで,今でもそれほど不便ないです.あと他に良いスクレイピングのライブラリ知らんというのもある.

githubは公式のAPIとメソッドが対応してるんで非常に使いやすいです.ただ(多分)oauthじゃないとAPIの時間制限があるので,注意してください.1h/60回かな?